Masalah Multikolinearitas: Sejauh Mana Kita Perlu Risau?

Salah satu isu yang kerap muncul ketika mengestimasi model

regresi dengan lebih dari satu variabel bebas (regresi berganda) adalah

multikolinearitas.

Multikolinearitas adalah kondisi saat variabel bebas saling

berkorelasi satu sama lain dengan derajat korelasi yang tinggi. Cara sederhana

untuk mendeteksi hal ini adalah dengan menghitung koefisien korelasi antar

variabel bebas. Selain itu, uji statistik untuk mendeteksi kehadiran

multikolineraitas juga bisa dilakukan.

Dalam prakteknya, korelasi tinggi bermakna relatif dan

cenderung subyektif. Karena itu, multikolinearitas adalah sesuatu yang sulit

dihindari ketika menggunakan regresi berganda. Apalagi ketika model digunakan

untuk menganalisis data sampel. Konsekuensi kehadirannya pada dasarnya tidak

mereduksi keunggulan hasil estimasi koefisen regresi dengan metode OLS. Dengan

kata lain, di tengah kehadiran multikolinearitas hasil estimasi koefisien

regreresi tetap memiliki fitur yang diinginkan, yakni tidak bias, konsisten,

dan efisien (BLUE).

Namun demikian, pada derajat tertentu, kehadiran

multikolinearitas dapat memunculkan persoalan serius yang perlu dirisaukan.

Multikolinearitas sempurna, misalnya, menyebabkan kita dihadapkan pada kondisi

yang disebut (near) singular matriks. Konsekuensinya, estimasi koefisien regresi

dengan metode OLS tidak bisa dilakukan karena matriks X’X tidak memiliki

invers. Secara teori, hal ini disebabkan matriks tersebut memiliki

determinan nol (atau mendekati nol).

Karena itu, mengetahui derajat korelasi antar variable bebas

merupakan petunjuk yang sangat berguna untuk mengidentifikasi apakah persoalan

multikolinearitas perlu dirisaukan atau tidak. Dengan mengasumsikan bahwa model

regresi hanya terdiri dari dua variabel bebas (katakan: X1 dan X2) berikut

adalah sejumlah rule of thumbs terkait koefisien korelasi antar variabel bebas

yang dapat dijadikan acuan dalam mengidentifikasi seberapa buruk konsekuensi

yang (bakal) ditimbulkan oleh kehadiran multikolinearitas. Aturan berikut juga

berlaku pada model regresi dengan lebih dari dua variabel bebas.

Sama

sekali tidak ada multikolinearitas (r2=0): hal ini merupakan kondisi ekstrim

yang hampir pasti tidak pernah terjadi. Konsekuensi dari kondisi ini justru

perlu dirisaukan karena berdampak penggunaan regresi berganda menjadi tidak

perlu. Persoalannya adalah penggunaan regresi sederhana secara parsial untuk

masing-masing variabel bebas bakal menghasilkan estimasi koefisien regresi yang

bias ke atas (upwardly bias). Hal ini terjadi karena model regresi sederhana

tidak mengontrol dampak variabel lain yang juga memengaruhi variabel bebas

(omitted variable bias).

Multikolinearitas

sempurna (r2=1): kondisi ini merupakan situasi ekstrim lainnya yang terjadi

ketika salah satu variabel bebas dapat dinyatakan secara persis sebagai fungsi

linear dari variabel bebas lainnya (misalnya X1 = a + bX2). Seperti disebutkan

sebelumnya, konsekuensi dari hal ini adalah estimasi koefisien regresi tidak

bisa dilakukan. Itulah sebabnya, salah satu asumsi yang harus dipenuhi dalam

mengestimasi model regresi adalah tidak ada multikolinearitas sempurna.

Multikolinearitas

tidak sempurna (0<r2<1): kondisi ini merupakan yang paling lazim

dijumpai. Pada dasarnya jika derajat korelasi relatif rendah atau moderat,

kehadiran multikolinearitas tak perlu dirisaukan. Untuk meyakinkan, sepanjang

hasil estimasi koefisen regresi masuk akal atau tidak aneh (make sense), yang

ditunjukkan dengan tanda, magnitude, dan signifikansi hasil estimasi yang bisa

diterima, kita tidak perlu khawatir. Kita perlu risau ketika derajat korelasi

relatif tinggi. Konsekuensi dari hal ini biasanya adalah hilangnya presisi

hasil estimasi koefisien regresi yang dietimasi dengan metode OLS. Sejumlah

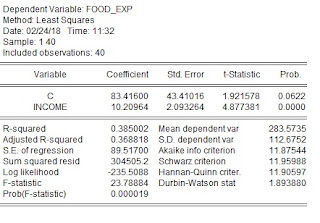

indikasinya adalah besarnya nilai estimasi kesalahan baku koefisien regresi, kecilnya nilai t-statistik (p-value tinggi) sehingga variabel bebas menjadi tidak

signifikan secara statistik dalam memengaruhi variabel tak bebas (padahal

realitasnya bisa jadi tidak demikian), serta tanda dan magnitude hasil estimasi

koefisien regresi tidak seperti yang diharapkan (misalnya berlawanan dengan teori). Kesimpulan yang dibangun

berdasarkan kondisi ini tentu bakal keliru dan menyesatkan.

Kesimpulan: Multikolinearitas tak perlu dirisaukan dan dapat

diabaikan sepanjang kehadirannya tidak "menggangu" hasil estimasi

koefisien regresi. Kita hanya perlu risau ketika kehadarinnya mereduksi presisi

hasil estimasi secara signifikan dan ketika kita dihadapkan pada dua kondisi

ekstrem yang telah disebutkan di atas.

Komentar

Posting Komentar